Вітаю! 🙋 Сьогодні для вас свіжа порція новин про оновлення технологічних продуктів! 📣

Спільна робота OpenAI, Google, Microsoft та Anthropic над регулюванням ШІ

Чотири провідні компанії в галузі штучного інтелекту – OpenAI, Microsoft, Google та Anthropic – об’єднали зусилля для створення Форуму Frontier Model. Цей галузевий орган має на меті забезпечити, щоб розробка ШІ та моделей машинного навчання, особливо так званого “передового ШІ”, велася безпечно та відповідально.

OpenAI 6 липня ввів поняття “прикордонний штучний інтелект”, визначивши його як моделі, що несуть ризики для суспільної безпеки.

Основні завдання цього форуму:

- Стимулювання досліджень у сфері безпеки ШІ.

- Розробка чітких практичних рекомендацій для створення та використання передових моделей.

- Активна співпраця з усіма зацікавленими сторонами.

- Підтримка ініціатив, спрямованих на вирішення проблем.

Створення Frontier Model Forum підкреслює прагнення індустрії до вирішення проблем безпеки, а також проактивний підхід технологічних гігантів до управління процесом регулювання через спільні ініціативи.

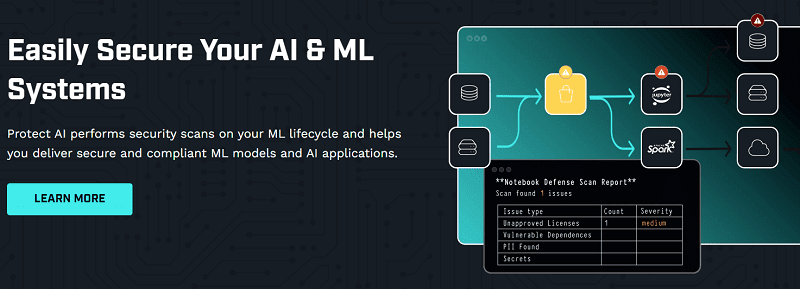

Protect AI проводить сканування безпеки та забезпечує захист систем машинного навчання (ML) і штучного інтелекту, гарантуючи безпечні та відповідні моделі машинного навчання і ШІ-програми. Компанія забезпечує аналіз загроз, тестування безпеки та виправлення проблем у системах ШІ та ML.

Protect AI отримала 35 мільйонів доларів США в ході фінансування серії A під керівництвом Evolution Equity Partners, за участі Salesforce Ventures та наявних інвесторів. На сьогодні компанія залучила 48,5 мільйонів доларів США, щоб допомогти організаціям захистити їхні системи машинного навчання та програми штучного інтелекту від унікальних вразливостей, витоку даних та нових загроз.

Інструмент NB Defense від Protect AI забезпечує захист ноутбуків Jupyter Lab, підвищуючи ефективність роботи та співпрацю. Він знижує ризики, проводить сканування безпеки та надає корисну аналітичну інформацію. Інструменти штучного інтелекту забезпечують захист ланцюга постачання програмного забезпечення машинного навчання, автоматично скануючи та усуваючи проблемні елементи.

Trustmi залучає 17 мільйонів доларів для вдосконалення технології захисту від платіжного шахрайства

Trustmi використовує штучний інтелект, машинне навчання та аналіз даних для проактивного виявлення та запобігання шахрайським транзакціям. Платформа пропонує різноманітні функції, що дозволяють компаніям підвищити безпеку своїх платіжних операцій.

Серед цих функцій:

- Моніторинг платежів на предмет підозрілої активності, такої як транзакції з країнами високого ризику або платежі від невідомих постачальників.

- Перевірка платежів шляхом їх зіставлення з різними джерелами даних, включаючи чорні списки кредитних карток та списки відповідності постачальників.

- Надання користувачам можливості контролювати платежі, дозволяючи їм схвалювати або відхиляти транзакції, а також встановлювати обмеження для певних постачальників.

Компанія залучила 17 мільйонів доларів у ході раунду серії А, збільшивши загальний обсяг інвестицій до 21 мільйона доларів. Лідером раунду виступила компанія Cyberstarts за участі Zeev Ventures.

Щоб бути в курсі останніх подій, перегляньте розділ “Останні технології”.