Якщо вас цікавить штучний інтелект, ця стаття стане для вас цінним ресурсом для глибшого розуміння його тонкощів. Я тут, щоб провести вас через лабіринт платформ LLMOps та роз’яснити важливі інструменти, призначені для тестування, вдосконалення та розгортання великих мовних моделей (LLM).

Платформи, згадані в цьому огляді, відіграють важливу роль у реалізації повного потенціалу мовних моделей, пропонуючи новаторські рішення для розробки та управління.

Провідні організації, такі як Google, OpenAI та Microsoft, використовують платформи LLMOps для забезпечення ретельного тестування, безперервного вдосконалення та ефективного розгортання своїх мовних моделей, гарантуючи їхню надійність та точність.

Оскільки концепція LLMOps може бути новою для багатьох, почнемо з основних принципів: розглянемо її значення, функції та переваги.

Маючи таке розуміння, ми можемо перейти до нашої головної мети – ідентифікації найкращих інструментів для наших читачів, виходячи з їхніх конкретних потреб. Список, який ви знайдете нижче, стане вам у цьому орієнтиром.

Що таке LLMOps?

LLMOps розшифровується як “Language Model Operations” (операції з мовними моделями). Це галузь, що займається управлінням, розгортанням та вдосконаленням великих мовних моделей, таких як ті, що використовуються в ШІ. LLMOps включає в себе набір інструментів та процесів для навчання, тестування та підтримки цих моделей, гарантуючи їхню ефективну роботу та точність протягом тривалого часу.

Хоча створити прототип LLM досить легко, їхнє використання в комерційних продуктах створює ряд викликів. Цикл розробки LLM включає такі складні етапи, як підготовка даних, налаштування моделі та розгортання, що вимагає безперебійної співпраці в команді. LLMOps охоплює весь цей цикл, забезпечуючи плавне експериментування, розгортання та вдосконалення.

Насамкінець, важливо розуміти, що саме являє собою платформа LLMOps, оскільки це забезпечить чітке розуміння та впевненість у подальшому вивченні цієї теми.

Платформа LLMOps сприяє співпраці між науковцями та інженерами з обробки даних, заохочуючи ітеративне дослідження даних. Вона забезпечує можливість спільної роботи в реальному часі, відстеження експериментів, управління моделлю та контрольоване розгортання LLM. LLMOps автоматизує процеси, синхронізацію та моніторинг протягом усього життєвого циклу машинного навчання.

Як працює LLMOps?

Платформи LLMOps спрощують увесь життєвий цикл мовних моделей. Вони централізують підготовку даних, сприяють експериментуванню та дозволяють точно налаштовувати моделі для конкретних завдань. Ці платформи також забезпечують плавне розгортання, безперервний моніторинг та просту зміну версій.

Сприяється співпраця, мінімізуються помилки завдяки автоматизації та підтримується постійне вдосконалення. По суті, LLMOps оптимізує управління мовною моделлю для різних сфер застосування.

Переваги LLMOps

Основні переваги, які я вважаю важливими, – це ефективність, точність та масштабованість. Ось детальний перелік переваг, які надає LLMOps:

- Ефективність: Платформи LLMOps оптимізують повний цикл розробки, тестування та розгортання мовної моделі, заощаджуючи час та ресурси.

- Співпраця: Ці платформи сприяють безперебійній співпраці між дослідниками даних, інженерами та іншими зацікавленими сторонами, забезпечуючи ефективну командну роботу.

- Точність: LLMOps підтримують та підвищують точність моделі з часом шляхом постійного моніторингу та вдосконалення моделей.

- Автоматизація: LLMOps автоматизує багато завдань, включаючи попередню обробку даних та моніторинг, зменшуючи потребу в ручному втручанні.

- Масштабованість: Завдяки можливості ефективного масштабування моделей, платформи LLMOps можуть легко адаптуватися до зростаючих робочих навантажень або вимог.

- Легкість розгортання: LLMOps забезпечує плавну інтеграцію моделей у додатки чи системи, мінімізуючи проблеми, пов’язані з розгортанням.

Отже, LLMOps підвищує ефективність, точність та масштабованість, одночасно сприяючи співпраці, автоматизації та безперебійному розгортанню.

А тепер перейдемо до нашого списку платформ. Цей список було зібрано з techukraine.net, але рішення про вибір найкращої для вас, виходячи з ваших вимог і потреб, залежить лише від вас.

Dify

Вас надихає стрімкий розвиток технологій LLM, таких як GPT-4, і ви в захваті від їхнього потенціалу для практичного застосування? Dify створено саме для вас. Він дозволяє розробникам, і навіть тим, хто не має глибоких технічних знань, швидко створювати корисні програми, використовуючи передові мовні моделі. Ці програми не тільки зручні, вони також розроблені для постійного вдосконалення.

Ключові особливості:

- Зручна платформа LLMOps: Легко розробляйте та візуально керуйте програмами ШІ на основі GPT-4.

- Контекстний ШІ з вашими даними: Використовуйте документи, веб-контент або нотатки Notion як контекст для ШІ. Dify виконує попередню обробку та інші операції, заощаджуючи ваш час на розробку.

- Розкрийте потенціал LLM: Dify забезпечує простий доступ до моделі, вбудовування контексту, контроль витрат та анотацію даних для безпроблемного створення ШІ.

- Готові шаблони: Обирайте з різноманітних шаблонів для діалогів та генерації тексту, які можна налаштувати для ваших конкретних програм.

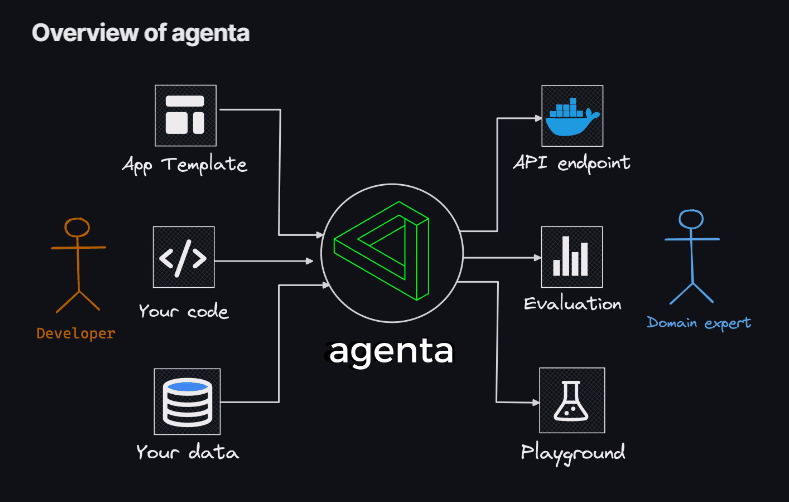

Agenta

Якщо вам потрібна свобода використання коду для створення програм LLM, вільних від обмежень певних моделей, бібліотек або фреймворків, тоді Agenta – ваш ідеальний вибір. Agenta – це наскрізна платформа з відкритим кодом, розроблена для оптимізації процесу розгортання складних додатків на основі великих мовних моделей (LLM).

З Agenta ви можете швидко експериментувати з версіями підказок, параметрами та складними стратегіями. Це включає в себе навчання в контексті за допомогою вбудовування, агентів та спеціальної бізнес-логіки.

Ключові особливості:

- Дослідження параметрів: Задайте параметри програми безпосередньо в коді та легко експериментуйте з ними за допомогою інтуїтивно зрозумілої веб-платформи.

- Оцінка продуктивності: Оцінюйте ефективність вашої програми на наборах тестів за допомогою різних методологій, таких як точна відповідність, AI Critic, оцінка експертів та інші.

- Платформа тестування: Легко створюйте набори тестів через інтерфейс користувача, завантажуючи файли CSV або підключаючи дані через наш API.

- Середовище для співпраці: Сприяйте командній роботі, ділячись своїм додатком з колегами та отримуючи відгуки.

- Просте розгортання: Запускайте свій додаток як API в один клік, спрощуючи процес розгортання.

Крім того, Agenta сприяє співпраці з експертами для швидкого проєктування та оцінки. Важливою особливістю є здатність Agenta систематично оцінювати ваші програми LLM та полегшувати їхнє розгортання одним кліком.

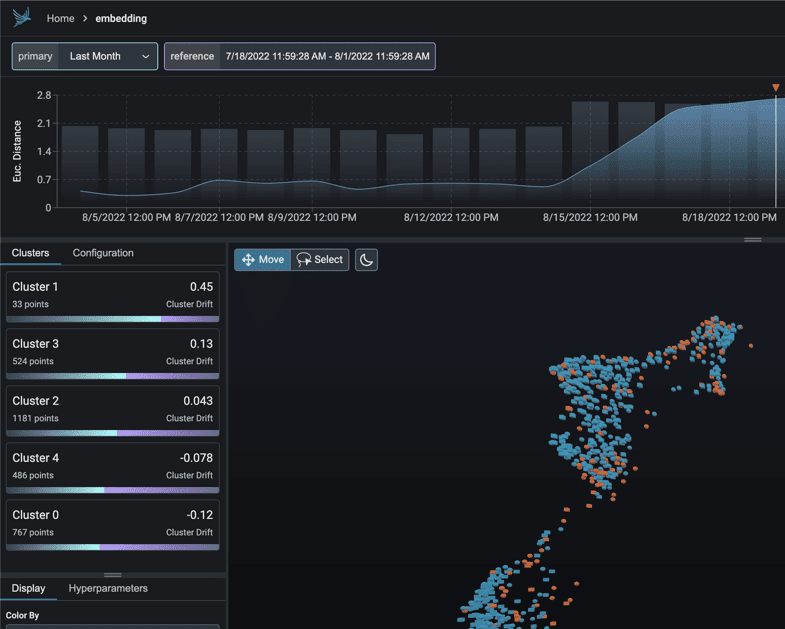

Phoenix

Відкрийте для себе нові можливості спостереження за MLOps з допомогою Phoenix. Цей інструмент дозволяє легко відстежувати продуктивність моделі, дрейф даних та їхню якість без складних налаштувань.

Phoenix – це сучасна бібліотека Python, орієнтована на ноутбуки, що використовує можливості вбудовування для розкриття складнощів у LLM, CV, NLP та табличних моделях. Покращуйте свої моделі завдяки неперевершеним можливостям Phoenix.

Ключові особливості:

- Вбудоване дослідження дрейфу: Зануртеся в хмари точок UMAP, аналізуючи значні евклідові відстані та кластери дрейфу.

- Аналіз дрейфу та продуктивності за допомогою кластеризації: Розділіть свої дані на кластери зі значним дрейфом або низькою продуктивністю за допомогою HDBSCAN.

- Дослідницький аналіз даних на основі UMAP: Кольорово кодуйте хмари точок UMAP за атрибутами, дрейфом та продуктивністю моделі, виявляючи проблемні сегменти.

LangKit

LangKit – це набір інструментів з відкритим кодом для аналізу тексту, розроблений для ефективного моніторингу великих мовних моделей.

Створення LangKit зумовлене розумінням того, що перетворення мовних моделей, зокрема LLM, на продуктивні, пов’язане з різними ризиками. Незліченні комбінації вхідних даних, що призводять до великої кількості результатів, створюють серйозні труднощі.

Ключові особливості:

- Аналіз швидких ін’єкцій: Вимірюйте показники схожості з відомими атаками швидкої ін’єкції.

- Аналіз настроїв: Оцінюйте тональність тексту.

- Оцінка якості тексту: Аналізуйте читабельність, складність та оцінку тексту.

- Виявлення втечі з “в’язниці”: Визначайте показники схожості з відомими спробами обходу обмежень.

- Аналіз токсичності: Виявляйте рівень токсичності в наданому тексті.

Неструктурований характер тексту ще більше ускладнює питання спостереження в машинному навчанні, і цю проблему необхідно вирішувати. Зрештою, відсутність розуміння поведінки моделі може мати серйозні наслідки.

LiteLLM

З LiteLLM спростіть свою взаємодію з різними API LLM, такими як Anthropic, Huggingface, Cohere, Azure OpenAI тощо, використовуючи легкий пакет у форматі OpenAI.

Цей пакет спрощує процес виклику кінцевих точок API від таких провайдерів, як OpenAI, Azure, Cohere та Anthropic. Він перетворює вхідні дані на кінцеві точки завершення та вбудовування відповідного провайдера, забезпечуючи однорідний вихід. Ви завжди можете отримати доступ до текстових відповідей за адресою [‘choices’][0][‘message’][‘content’].

Ключові особливості:

- Оптимізований виклик LLM API: Спрощує взаємодію з LLM API, такими як Anthropic, Cohere, Azure OpenAI тощо.

- Легкий пакет: Компактне рішення для виклику кінцевих точок OpenAI, Azure, Cohere, Anthropic та інших API.

- Перетворення вхідних даних: Керує перетворенням вхідних даних до кінцевих точок завершення та вбудовування відповідного провайдера.

- Відображення винятків: Відображає загальні винятки провайдерів на типи винятків OpenAI для стандартизованої обробки помилок.

Крім того, пакет містить функцію відображення винятків. Він узгоджує стандартні винятки для різних провайдерів з типами винятків OpenAI, забезпечуючи послідовність обробки помилок.

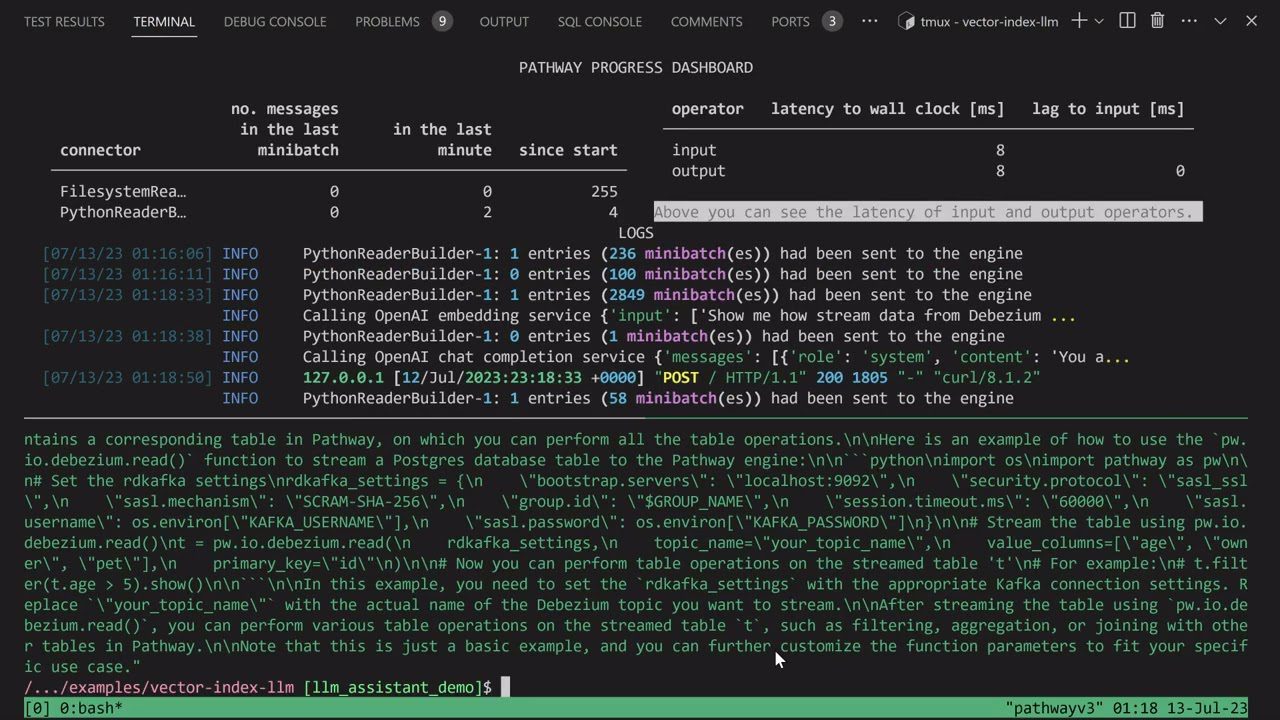

LLM-додаток

Створіть власного чат-бота Discord AI з можливістю відповіді на питання або вивчайте інші схожі ідеї ботів AI. Усі ці захоплюючі функції об’єднуються завдяки LLM-додатку.

Представляю Pathways LLM-App – бібліотеку Python, розроблену для прискорення створення інноваційних програм ШІ.

Ключові особливості:

- Створено для локальних моделей ML: LLM-додаток налаштовано для роботи з локальними моделями ML в межах вашої організації.

- Обробка даних в режимі реального часу: Ця бібліотека вміло керує живими джерелами даних, включаючи стрічки новин, API та потоки даних Kafka, з наданням прав користувача та надійним захистом.

- Плавні сесії користувача: Процес створення запитів у бібліотеці ефективно обробляє сесії користувачів, забезпечуючи безперебійну взаємодію.

Цей винятковий інструмент дозволяє вам надавати миттєві відповіді, що імітують людську взаємодію, під час вирішення запитів користувачів. Він досягає цього, ефективно спираючись на останні відомості з ваших джерел даних.

LLMFlows

LLMFlows – це фреймворк, створений для спрощення, уточнення та забезпечення прозорості розробки додатків на основі великих мовних моделей (LLM), таких як чат-боти, системи відповідей на запитання та агенти.

Складність може зростати в реальних умовах через складні взаємозв’язки між підказками та викликами LLM.

Розробники LLMFlows створили чіткий API, який дозволяє користувачам писати чистий та зрозумілий код. Цей API спрощує створення складних взаємодій LLM, забезпечуючи безперебійний потік між різними моделями.

Ключові особливості:

- Легко налаштовуйте сеанси LLM, обираючи конкретні моделі, параметри та налаштування.

- Забезпечте надійну взаємодію LLM за допомогою автоматичних повторних спроб після збою виклику моделі, гарантуючи надійність.

- Оптимізуйте продуктивність та ефективність, використовуючи Async Flows для паралельного виконання LLM, коли вхідні дані доступні.

- Вбудовуйте персоналізовані функції обробки рядків безпосередньо в потоки, створюючи індивідуальні перетворення тексту поза викликами LLM.

- Підтримуйте повний контроль та нагляд за додатками на основі LLM за допомогою зворотних викликів, пропонуючи комплексний моніторинг та видимість процесів виконання.

Класи LLMFlows надають користувачам повний контроль без прихованих підказок або викликів LLM.

Promptfoo

Прискорюйте оцінювання завдяки кешуванню та одночасному тестуванню з promptfoo. Він надає інтерфейс командного рядка (CLI) та бібліотеку, що дозволяє оцінювати якість виводу LLM.

Ключові особливості:

- Перевірена надійність: Promptfoo розроблено для оцінювання та вдосконалення програм LLM, що обслуговують понад 10 мільйонів користувачів у робочому середовищі. Інструменти є гнучкими та адаптуються до різних налаштувань.

- Зручні тестові приклади: Визначайте критерії оцінювання без програмування та роботи з складними блокнотами. Простий декларативний підхід спрощує процес.

- Гнучкість мови: Незалежно від того, чи використовуєте ви Python, Javascript або будь-яку іншу мову, promptfoo відповідає вашим уподобанням.

Крім того, promptfoo дозволяє систематично перевіряти підказки на попередньо визначених тестових прикладах. Це допомагає оцінити якість та виявити регресії, спрощуючи пряме порівняння результатів LLM.

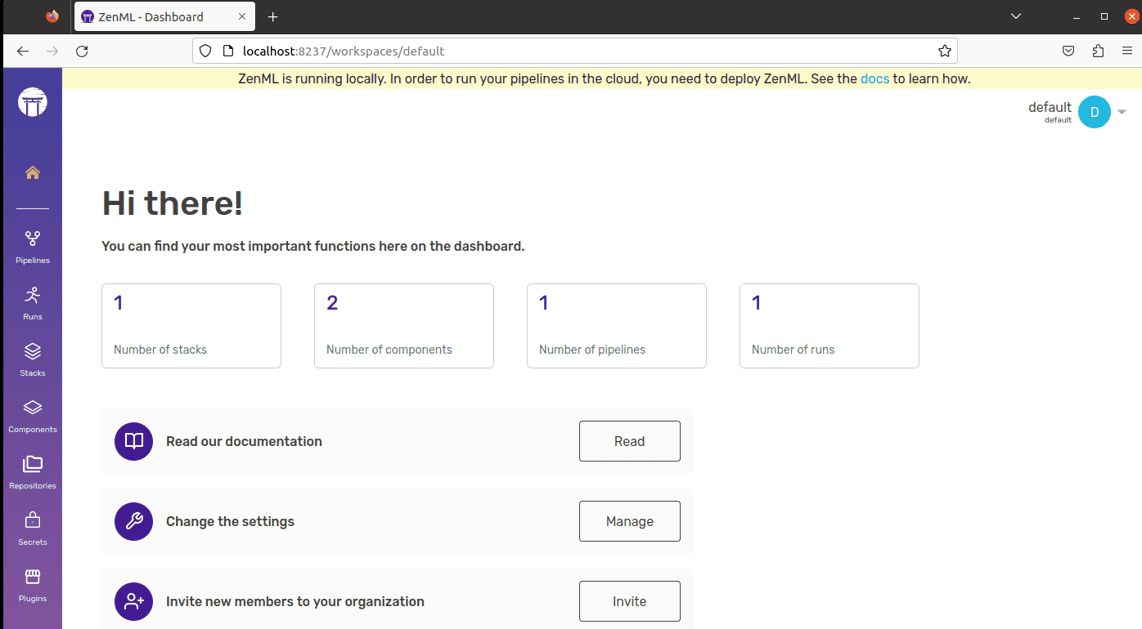

ZenML

Зустрічайте ZenML – адаптивний інструмент з відкритим кодом, призначений для полегшення створення конвеєрів машинного навчання для фахівців та організацій. Уявіть, що у вас є інструмент, який дозволяє створювати конвеєри машинного навчання, готові до використання в реальному світі, незалежно від складності проєкту.

ZenML відокремлює технічні елементи від коду, що полегшує спільну роботу розробників, спеціалістів з обробки даних, експертів MLOps та інженерів ML. Це означає, що ваші проєкти можуть легше переходити від ідеї до реалізації.

Ключові особливості:

- Для спеціалістів з обробки даних: Зосередьтеся на створенні та тестуванні моделей, тоді як ZenML готує ваш код до використання в реальному світі.

- Для експертів з інфраструктури MLOps: Швидко налаштовуйте, керуйте та розгортайте складні системи, щоб ваші колеги могли використовувати їх без проблем.

- Для інженерів ML: Керуйте кожним кроком вашого проєкту машинного навчання, від початку до кінця, за допомогою ZenML. Це зменшує необхідність передачі роботи та підвищує ясність у процесах вашої організації.

ZenML створено для всіх, незалежно від того, чи є ви фахівцем, чи членом організації. Він надає спосіб написання коду, призначений для завдань машинного навчання, і добре працює з будь-яким хмарним сервісом або інструментом. Крім того, він допомагає вам керувати проєктом в одному місці, тож вам не доведеться турбуватися про жонглювання різними речами. Просто напишіть свій код один раз і легко використовуйте його в інших системах.

Заключна думка

У цій захопливій подорожі пам’ятайте, що кожна платформа є унікальним ключем, який може відкрити ваші прагнення у світі ШІ. Ваш вибір може визначити ваш шлях, тож обирайте мудро!

Ви також можете ознайомитися з деякими інструментами ШІ для розробників, щоб пришвидшити створення програм.